Suita AI de la Nvidia poate deveni mult mai scumpă, datorită „greșelii” de matematică a GPU-ului a lui Jensen. La conferința sa de tehnologie GPU de luna trecută, Nvidia a rupt convențiile schimbându-și definiția a ceea ce contează ca un GPU, scrie The Register.

Urmărește cele mai noi producții video TechRider.ro

- articolul continuă mai jos -

Mai jos, pentru a lamuri confuzia de care vrea sa se folosească Nvidia, vom încerca să lămurim acești termeni. In tehnologia de calcul, „die” este folosit pentru a se referi la bucata fizică de siliciu din care este compusă unitatea de procesare (un GPU sau CPU). Die este adesea folosit interschimbabil cu „cip”.

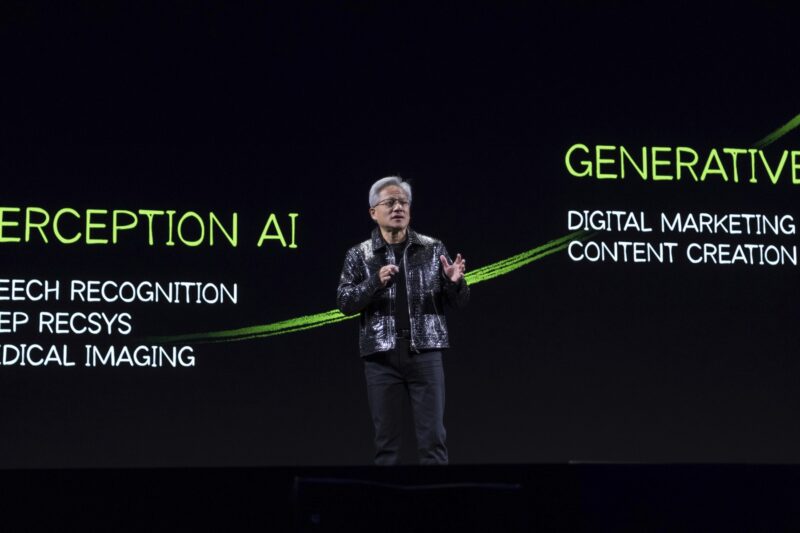

„Unul dintre lucrurile în care am greșit: Blackwell este într-adevăr două GPU-uri într-un singur cip Blackwell”, a explicat CEO-ul Jensen Huang pe scena de la GTC. „Am numit acel cip un GPU și asta a fost greșit. Motivul pentru asta este că strica toată nomenclatura NVLink.”

Cu toate acestea, trecerea Nvidia la numărarea cipurilor de GPU, mai degrabă decât a modulelor SXM, deoarece GPU-urile individuale nu simplifică doar numerele de model NVLink și convențiile de denumire. De asemenea, ar putea dubla numărul de licențe AI Enterprise pentru care Nvidia le poate taxa.

Suita AI Enterprise de la Nvidia, care acoperă o serie de servicii AI, inclusiv accesul la microserviciile sale de inferență (NIM), vor costa 4.500 USD pe an sau 1 USD pe oră în cloud, per GPU. Acest lucru însemna că un Nvidia HGX B200 cu opt module (un GPU Blackwell per modul) ar costa 36.000 USD pe an sau 8 USD pe oră în cloud.

Dar cu noul HGX B300 NVL16, Nvidia numără acum fiecare cip (die) ca un GPU. Și din moment ce sistemul are și opt module, fiecare cu două matrițe, ceea ce aduce totalul la 16 GPU-uri. Aceasta înseamnă că, presupunând că nu se vor schimba prețurile abonamentului AI Enterprise de la Nvidia, cele mai recente casete HGX vor costa de două ori mai mult.

Schimbarea convenției de denumire este o abatere de la sistemele Blackwell de anul trecut. La lansarea Blackwell, Nvidia a contestat faptul că noi numim Blackwell o arhitectură „chiplet” – mai multe matrițe(cipuri) separate sau chipleturi conectate într-un pachet de procesor – argumentând că este de fapt o „arhitectură cu două reticule limitate care acționează ca un singur GPU unificat”.

Nu se pare că cele mai recente GPU-uri B300 sunt mult mai puternice, față de B200 de anul trecut. Ca o reîmprospătare rapidă, HGX B300 oferă de aproximativ 1,5 ori mai multă capacitate de memorie la 2,3 TB față de 1,5 TB la B200, în timp ce performanța în virgulă mobilă pe 4 biți (FP4) crește cu aproximativ 50% până la puțin peste 105 petaFLOPS per sistem. Cu toate acestea, saltul de performanță este doar pentru sarcinile de lucru care pot profita de acea performanță FP4. La o precizie mai mare, B300 nu oferă niciun avantaj în virgulă mobilă față de sistemul mai vechi.

În mod confuz, această modificare se aplică doar sistemelor B300 răcite cu aer de la Nvidia și nu sistemelor mai puternice GB300 NVL72, care continuă să numere pachetele ca GPU.

Motivul pentru aceasta jonglerie: conform vicepreședintelui și directorului general al Hyperscale și HPC al Nvidia, Ian Buck, există un motiv tehnic pentru acest lucru.

Principala diferență este că pachetul B300 oferit pe șasiul HGX nu are interconectarea cip-la-cip (C2C) găsită pe acceleratoarele Blackwell din generația anterioară. Aceasta înseamnă că cele două cipuri sunt într-adevăr două GPU-uri distincte de 144 GB care împart un pachet comun. Buck a explicat că acest lucru a permis Nvidia să obțină o putere și o temperatură de lucru mai bune. Acest lucru vine cu unele dezavantaje. Deoarece nu există nicio interconexiune C2C între cele două, dacă un die (cip) dorește să acceseze memoria pe celălalt, trebuie să iasă din pachet, prin comutatorul NVLink și apoi să facă o întoarcere pe aceeași cale.

GB300, pe de altă parte, păstrează interfața C2C, evitând rutarea memoriei în afara pachetului. Deoarece cele două cipuri pot comunica direct și partaja memorie, sunt tratate ca un singur GPU unificat – cel puțin în ceea ce privește software-ul și licențele Nvidia.

Cu toate acestea, această excepție tehnică nu va dura mult, odată cu lansarea supercipurilor Vera Rubin de la Nvidia, care vor îmbrățișa convenția de denumire în stil B300 și vor începe să numere cipurile individuale ca GPU-uri, de unde și denumirea NVL144.

Acesta este, de asemenea, modul în care platforma Nvidia Vera Rubin Ultra, care va veni la sfârșitul anului 2027, poate revendica 576 de GPU-uri per rack. După cum se poate explora, în prezentarea Nvidia, sunt de fapt doar 144 de module – ceea ce înainte de Blackwell Ultra am fi considerat un GPU – cu patru cipuri (die) per modul.

Dacă ar trebui să ghicim, am paria, în anul de când Nvidia a dezvăluit Blackwell, gigantul GPU și-a dat seama că veniturile din abonament pentru software pot fi mult mai mari. Se presupune pentru moment deoarece, atunci când a fost întrebată Nvidia cum va afecta schimbarea denumirii licențele AI Enterprise, au spus că detaliile de preț nu au fost încă finalizate.

„Detaliile privind prețurile sunt încă în curs de finalizare pentru B300 și nu există detalii de împărtășit pentru Rubin în afară de ceea ce a fost afișat în prezentarea GTC în acest moment”, a declarat un purtător de cuvânt, care a clarificat că aceasta include și prețurile AI Enterprise.

Și din moment ce sistemul are și opt module, fiecare cu două matrițe, ceea ce aduce totalul la 16 GPU-uri.

Fraza nu are sens. Si nu e singura fraza. Nu stiu ce translalor // dar ar fi bine sa verificati ce scrieti pentru ca altfel // sens.

Are?

Are sens?