Cele mai recente modele OpenAI, lansate săptămâna aceasta, pot determina locația fotografiilor folosind indicii de context, pe care OpenAI le numește o „inovație semnificativă în percepția vizuală”.

Urmărește cele mai noi producții video TechRider.ro

- articolul continuă mai jos -

Utilizatorii pot încărca fotografii și îi cer ChatGPT să „ghicească” unde au fost făcute. Rezultatele acestei „căutări inverse a locației” sunt surprinzător de precise. Această capacitate există de ceva vreme, dar modelul OpenAI o3 ar putea să o popularizeze într-un mod major. Rețelele de socializare sunt deja în fierbere, relatează TechCrunch.

Utilizatorii ChatGPT au descoperit că popularul chatbot AI poate servi ca instrument de căutare inversă a locației. Cu alte cuvinte, puteți afișa ChatGPT o fotografie și vă poate spune destul de sigur unde a fost făcută. Tendința este inspirată de jocul online Geoguessr, în care oamenii încearcă să descopere o locație dintr-o simplă imagine web.

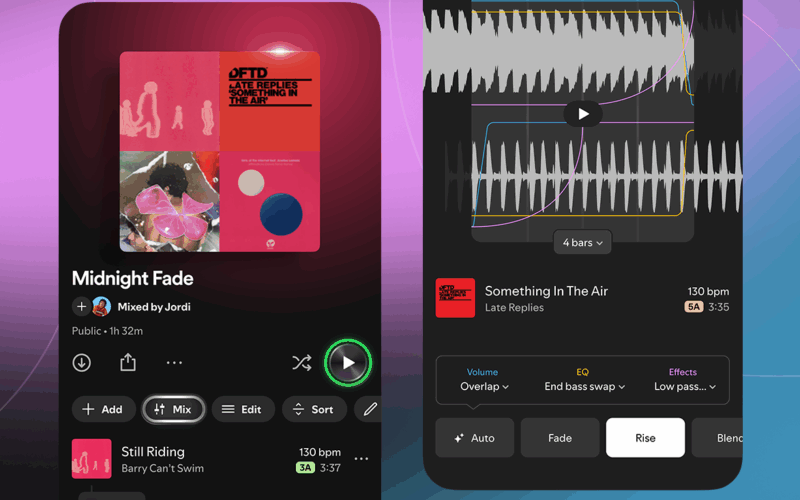

Săptămâna aceasta, OpenAI a lansat cele mai noi modele AI, o3 și o4-mini, ambele putând „raționa” în mod unic prin imaginile încărcate. În practică, modelele pot decupa, roti și mări fotografii – chiar și cele neclare și distorsionate – pentru a le analiza în detaliu.

Aceste capacități de analiză a imaginilor, combinate cu capacitatea modelelor de a căuta pe web, reprezintă un instrument puternic de găsire a locației. Utilizatorii au descoperit rapid că o3, în special, este destul de bun în a deduce orașe, repere și chiar restaurante și baruri din indicii vizuale subtile.

În multe cazuri, modelele nu par să se bazeze pe „amintiri” ale conversațiilor ChatGPT anterioare sau pe date EXIF, care sunt metadatele atașate fotografiilor care dezvăluie detalii precum locul în care a fost făcută fotografia. Unii utilizatori au șters aceste metadate pentru a testa capabilitățile modelului AI.

Este o problemă evidentă de confidențialitate. Nu există nimic care să împiedice un actor rău intenționat să facă capturi de ecran, să zicem, din Instagram Story a unei persoane și să folosească ChatGPT pentru a încerca doxx-ing.

Doxing sau doxxing (sunt folosite ambele forme) este acțiunea de a furniza public informații de identificare personală despre o persoană sau o organizație, de obicei prin Internet și fără consimțământul acestora. Din punct de vedere istoric, termenul a fost folosit pentru a se referi atât la agregarea acestor informații din baze de date publice și site-uri de social media (cum ar fi Facebook), cât și la publicarea informațiilor private anterior obținute prin mijloace criminale sau frauduloase (cum ar fi hacking și inginerie socială).

ChatGPT a identificat corect locația generală, sugerând chiar anumite blocuri cu apartamente și, într-un caz, o anumită adresă de domiciliu. În acel caz specific, adresa în cauză este o casă populară printre influenceri și a fost folosită pentru producții TV, dar detaliul a fost impresionant. Și puțin înfricoșător. Este încă un motiv pentru a fi atenți la ceea ce postați online – AI poate ajuta acum oamenii să deducă unde vă aflați. A făcut valuri la începutul acestui an un articol al 404 Media unde a raportat că ar putea fi exploatat de forțele de ordine și de urmăritori anonimi, deoarece utilizatorii ar putea cere ChatGPT să geolocalizeze fotografiile postate pe rețelele sociale.

ChatGPT poate combina, de asemenea, recunoașterea imaginii cu manipularea imaginii. Dacă utilizatorii încarcă o imagine imperfectă, ChatGPT poate muta elemente pentru a răspunde la întrebări despre aceasta.

Desigur, acest lucru ar putea fi făcut chiar înainte de lansarea lui o3 și o4-mini. Asta nu înseamnă că o3 este impecabil în acest sens. Câteva dintre testele utilizatorilor au eșuat — o3 a rămas blocat într-o buclă, nu a putut ajunge la un răspuns în care avea încredere în mod rezonabil sau a oferit voluntar o locație greșită. Utilizatorii au remarcat, de asemenea, că o3 poate fi destul de departe în deducerile de locație.

Dar tendința ilustrează unele dintre riscurile emergente prezentate de modelele AI mai capabile, așa-numitele raționale. Se pare că există puține măsuri de protecție pentru a preveni acest tip de „căutare inversă a locației” în ChatGPT, iar OpenAI, compania din spatele ChatGPT, nu abordează problema în raportul său de siguranță pentru o3 și o4-mini.

Un purtător de cuvânt al OpenAI a trimis TechCrunch următoarea declarație:

„OpenAI o3 și o4-mini aduc un raționament vizual în ChatGPT, făcându-l mai util în domenii precum accesibilitatea, cercetarea sau identificarea locațiilor în răspunsul la situații de urgență. Am lucrat pentru a pregăti modelele noastre să refuze cererile de informații private sau sensibile, am adăugat măsuri de protecție menite să interzică modelului să identifice persoane private în imagini și să monitorizăm activ politicile privind confidențialitatea și să luăm măsuri împotriva utilizării abuzului nostru.”