Distilarea face AI mai accesibilă lumii prin reducerea dimensiunii modelului

Urmărește cele mai noi producții video TechRider.ro

- articolul continuă mai jos -

Distilarea, cunoscută și sub denumirea de distilare a modelului sau distilare a cunoștințelor, este un proces în care informațiile sunt transferate de la un model AI mare și complex „profesor” AI la un model de AI „student” mai mic și mai eficient ne prezintă TechRadar.

Procedând astfel, se creează un fișier model mult mai mic care, deși păstrează o mare parte din calitatea „profesorului”, reduce semnificativ cerințele de calcul.

Utilizarea distilării este foarte populară în comunitatea open source, deoarece permite implementarea modelelor AI compacte pe sistemele computerelor personale.

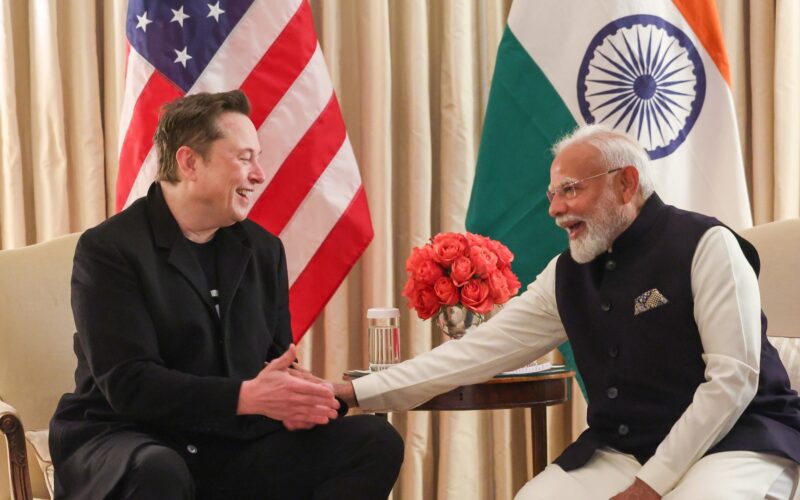

Un exemplu popular este gama largă de modele distilate mai mici care au fost create în întreaga lume la scurt timp după lansarea platformei open source DeepSeek R1.

Istoria Distilării

Conceptul de distilare a fost introdus pentru prima dată de Geoffrey Hinton (alias „nașul AI”) și echipa sa în 2015. Tehnica a câștigat imediat popularitate ca fiind una dintre cele mai bune modalități de a face modele AI avansate funcționale pe platforme de calcul modeste.

Distilarea a permis și continuă să permită utilizarea pe scară largă a aplicațiilor AI de zi cu zi – care altfel ar trebui procesate de computere uriașe bazate pe cloud.

Cele mai multe modele distilate pot fi rulate pe computerele de acasă și, ca rezultat, există sute de mii de aplicații AI în uz în întreaga lume, care efectuează sarcini precum generarea de muzică și imagini sau știință hobbyist.

Distilarea funcționează prin utilizarea modelului profesorului mai mare pentru a genera rezultate pe care modelul elevului învață apoi să le mimeze.

În loc să copieze pur și simplu aceste rezultate, modelul elevului învață de obicei din ele și le folosește pentru a crea o clonă mai mică a profesorului. Nu doar sectorul open source folosește distilarea.

Toate modelele de bază de la companii precum OpenAI și Google sunt de obicei distilate în versiuni mai ușor de gestionat pentru distribuție către companii și persoane fizice.

Aceste companii oferă adesea instrumente de distilare clienților lor de top pentru a-i ajuta să creeze versiuni de model mai mici.

Distilare sau reglaj fin

Trebuie remarcat faptul că distilarea este complet diferită de reglarea fină.

Distilarea creează un nou model mai mic care emulează comportamentul celui mai mare, în timp ce reglarea fină adaptează un model la o anumită sarcină, antrenându-l pe date specifice sarcinii.

Destul de interesant, atât modelele distilate, cât și cele reglate fin își pot depăși uneori pe frații lor mai mari în sarcini sau roluri specifice.

Cu toate acestea, în cazul distilării, modelul rezultat va pierde o parte din cunoștințele ample pe care modelul principal le conținea inițial. Nu este neapărat cazul modelelor reglate fin.

Există trei metode principale de distilare, cu tehnici bazate pe răspuns, caracteristici și relații.

Fără a intra în prea multe detalii tehnice, fiecare metodă se concentrează pe un mod diferit de a emula calitățile modelului original.

Și fiecare abordare oferă beneficii și dezavantaje în ceea ce privește calitatea modelului de student rezultat.

Din acest motiv, diferitele companii de ce dezvoltă modele AI adoptă metode diferite, pentru a încerca să obțină avantaje de performanță pe piață.

Importanța distilării

Distilarea este acum o parte esențială a lumii AI pentru întreprinderi, deoarece, de-a lungul timpului, modelele emblematice de bază au crescut și au nevoie de resurse masive pentru a funcționa.

În loc să proceseze trilioane de parametri, având nevoie de centre de date și surse de alimentare de dimensiunea unor orașe, modelele mai mici, distilate pot fi rulate la sediu de mari corporații și organizații guvernamentale.

Disponibilitatea pe scară largă a acestor tipuri de opțiuni face AI o tehnologie mai democratică și deschide beneficiile unui public mult mai larg. De asemenea, deschide ușa către aplicații AI mai private și mai sigure.

Există și alte avantaje care provin din distilare. Modelele mai mici rulează mai repede și folosesc energie semnificativ mai mică.

De asemenea, rulează într-o amprentă de memorie mult mai mică și pot fi antrenați pentru sarcini specializate.

Aceste beneficii au transformat distilarea într-o trăsătură esențială a peisajului AI modern, creând o punte între modelele de fundație extrem de scumpe și aplicațiile practice de care pot beneficia utilizatorii obișnuiți.